NDS #73 - Ejército de agentes, checklists SEO técnico, htaccess... MCP Chrome DEV tools, los LLMs te hacen peor profesional, tendencias SEO en ecommerce y más...

Analizamos las novedades semanales del sector SEO e IA y sobre todo cómo nos puede afectar como consultores y te cuento mis vivencias y aprendizajes sentado varias horas al día frente a un monitor.

Me hace mucha ilusión saludarte en esta edición de la newsletter NDS, espero que cumpla tus expectativas y si es así, o si no lo es, estaré encantado de que me des feedback.

¿Quién es Javier Flores y qué es NDS? :)

👨💻 ¡Hola! Soy Javier Flores, consultor SEO en VisibilidadOn y creador de Notas de SEO (NDS), que estás leyendo ahora mismo. Esta newsletter nació en noviembre de 2024 como un espacio para compartir mis aprendizajes en SEO, marketing y negocios digitales. Si te gusta, dime qué opinas. Y si no... ¡también! 😉

🗂️ En el correo de hoy

1️⃣ La viñeta

2️⃣ Actualidad SEO

3️⃣ Tendencias en ecommerce

4️⃣ Checklist .htaccess para SEO

5️⃣ Recursos / herramientas

6️⃣ MCP Chrome Dev Tools

7️⃣ El día que Google compró el aire de Internet

🛒 En la agencia hemos publicado un benchmark sobre canales de tráfico en eCommerce con datos serios detrás, más de 130 cuentas de Google Analytics 4 analizadas, más de 100 proyectos eCommerce y +38 millones de sesiones del periodo 2025.

El estudio responde a tres bloques de preguntas, distribución del tráfico (qué porcentaje llega de SEO, Paid, Direct, Social, Email y Referral), calidad del tráfico (engagement rate, tiempo medio de interacción, rebote, profundidad de sesión) y rentabilidad por canal (conversion rate, revenue por sesión, ticket medio y ventas generadas).

Si llevas una tienda online, sirve para responder cosas que casi nadie tiene benchmarkeadas con números reales del mercado español, si dependes demasiado de un solo canal, si estás comprando tráfico poco rentable, dónde tienes margen real de crecimiento y, sobre todo, cómo estás comparado con la media del sector.

🖌️ La viñeta

📸 Actualidad SEO

Noticias que lees en un ratillo.

[🚨 ¡Los LLMs te hacen peor profesional! ¡Corrompen tu trabajo!] Natzir desgrana en X un paper recién publicado por Microsoft Research (Laban, Schnabel, Neville) que presenta DELEGATE-52, un benchmark con 52 dominios profesionales (código, contabilidad, subtítulos, notación musical…) para medir cuánto se degrada un documento cuando dejas que el LLM lo edite en cadena.

La prueba es bonita, el modelo hace una edición, después otra que debería deshacerla, se encadenan varias rondas y se compara el documento final con el original.

¿Has oído hablar del teléfono escacharrado? 🤣

Resultados, los modelos frontier corrompen un 25% del contenido al final de workflows largos, los pequeños rinden aún peor y usar tools no solo no ayuda sino que dispara el coste (invocan entre 8 y 12 de media y gastan de 2 a 5 veces más tokens). A más largo el documento y más larga la cadena de ediciones, más se rompe todo.

La propia Microsoft ha colado en los términos de Copilot que la herramienta es “for entertainment purposes only. Don’t rely on Copilot for important advice”. Vamos, que no se fían ni ellos de su propia IA.. xD

[🛒 Shopify AI Toolkit] Shopify ha publicado un toolkit oficial para conectar agentes de IA a su plataforma con la documentación, los schemas de su API y validación de código integrados, además de poder ejecutar acciones sobre la tienda desde el CLI. La idea es que el agente trabaje contra Shopify en condiciones en vez de tener que adivinar cómo están implementadas las cosas.

Tienes tres caminos de instalación, el plugin oficial (la opción recomendada, se actualiza solo según salgan nuevas capacidades), copiar manualmente los ficheros de skills del agente, o conectarte a través de su servidor MCP de desarrollo.

Si llevas tiendas Shopify y has empezado a montar flujos con Claude Code o agentes en terminal, encaja con la arquitectura que comenta Lino en el siguiente artículo al inicio, que el agente ejecute y valide contra la API real en vez de inventarse cómo se hace algo.

[🏗️ Arquitectura de agentes para SEO] Lino Uruñuela (Funnel▼Punk) abre el capó de su maquinaria y comparte cómo está montando su workspace de agentes con Claude Code para automatizar análisis SEO recurrentes. Enseña la estructura real de carpetas, su CLAUDE.md como system prompt del agente, las skills en XML con SOPs versionados, plantillas para análisis de tráfico, técnico, QA de entornos y datos estructurados, e incluso un fichero fallos-sql-correcciones.md donde guarda los errores que ya cometió el LLM para que no los repita en la siguiente sesión.

Plantea tres niveles de adopción de IA y se sitúa honestamente en el dos (agentes en terminal con procesos encadenados), el tres, la orquestación multiagente, lo deja como horizonte. Y ojo a esto, procesar HTML puede costar hasta un 75% más en tokens que texto plano (de ahí que use trafilatura y shot-scraper para extraer solo lo necesario), y reserva Claude para el razonamiento serio descargando en modelos locales como Qwen las tareas de clasificación o resumen.

Su opinión del futuro SEO, el SEO técnico del futuro pesará menos en saber JS, CSS o HTML, y más en conocer el producto, al cliente y cómo darle el contexto correcto al agente para que ejecute.

[🛒 Tendencias en ecommerce este Q1 ] En este episodio de VisibilidadON reunimos al equipo de VisibilidadON (entre los que estoy yo xD) para analizar qué está pasando de verdad en el ecosistema eCommerce. Sin ruido y sin titulares vacíos, hablamos de Google Ads, SEO, Shopify, inteligencia artificial, atribución, automatización y los cambios que ya están afectando ventas y rentabilidad.

[🛡️Google Maps bloqueó 292 millones de reseñas y 13 millones de perfiles falsos en 2025] Barry Schwartz se hace eco del informe anual de seguridad de Google Maps, 292 millones de reseñas eliminadas por violar políticas (un 21% más que el año pasado), 13 millones de perfiles de empresa falsos, 79 millones de ediciones inexactas bloqueadas y restricciones de publicación a más de 783.000 cuentas.

Google está apoyándose en las capacidades de razonamiento de Gemini para tumbar reseñas problemáticas antes de que se publiquen (sobre todo cuando hay matiz político o social) y va a empezar a enviar alertas por email a los propietarios verificados para que puedan revisar ediciones importantes en sus fichas antes de que entren en vivo.

[🔍 Scanner para ver tu web como la ven los crawlers de IA] Lily Ray ha publicado su LLM Content Visibility Scanner, una herramienta gratuita donde pegas una URL y te enseña qué ve realmente GPTBot, ClaudeBot y PerplexityBot cuando rastrean tu página sin ejecutar JavaScript (que es como la mayoría de bots LLM piden el contenido, a diferencia de Googlebot).

Audita la HTML cruda buscando los problemas típicos: contenido renderizado en cliente, datos estructurados ausentes, paywalls, alt text faltante y problemas de rastreo. Te devuelve un mini plan de acción priorizado con las URLs concretas a tocar y algo de metadata extra.

[🐸 Checklist de SEO Técnico] MJ Cachon firma en el blog de DebugBear una guía de SEO técnico actualizada al ecosistema actual donde Google ya no es el único destino. Cubre crawling, indexación, performance, rendering JS, seguridad, multi-plataforma y remata con un checklist interactivo de 74 ítems filtrables por prioridad y por si afectan a Search, IA o UX.

Dos cosas que merece la pena fijar aunque no leas el resto, la tabla de user-agents IA (GPTBot vs OAI-SearchBot vs ChatGPT-User, ClaudeBot vs Claude-SearchBot vs Claude-User, Google-Extended…) que separa los bots de entrenamiento de los que rastrean en tiempo real para citar fuentes, útil cuando toca decidir a quién bloqueas en robots.txt; y el recordatorio de que la mayoría de bots IA no ejecutan JavaScript, así que si tu contenido depende de CSR es invisible para Perplexity, ChatGPT o Claude.

[🏛️ Un LLM previo a 1930] Un muy curioso experimento, un LLM entrenado con documentos anteriores a 1930, libros, informes, leyes, etc… me dio por preguntarle cómo curar la gripe y me tuvo ¡una semana sólo bebiendo leche y tumbado en la cama! 😅

[🛠️ Cómo construir skills de agentes SEO que funcionen de verdad] Itay Malinski (Aloha Digital) cuenta en Search Engine Land cómo ha montado más de 10 skills de agentes SEO en 34 días y por qué la mayoría de skills que circulan por LinkedIn fallan, son un único prompt, sin tools, sin verificación y sin memoria. Una moneda al aire con buena maquetación.

Su propuesta encaja como un guante con la arquitectura que comparte Lino, cada agente vive en un workspace con su AGENTS.md (instrucciones), SOUL.md (principios de calidad), scripts/ (las herramientas reales que llama el agente, con headers y rate limiting bien hechos para no comerse 403s), references/ (criterios de severidad y gotchas conocidas), memory/runs.log (qué encontró la última vez, para poder comparar) y templates/ con esquema de salida estricto y campos cerrados, sin que al agente se le ocurra renombrar “severity” como “priority” entre runs.

[🛍️ 4 tendencias clave de eCommerce para 2026] Alison Zeller resume en Search Engine Land las cuatro corrientes que van a marcar el comercio electrónico este año.

Agentes IA comprando (el tráfico desde motores IA a retail creció un 4.700% YoY hasta julio de 2025 según Adobe, y un tercio de compradores ya dejaría que la IA comprase en su nombre), salto de omnichannel a unified commerce (subida media del 9% en ventas anuales para los retailers que lo implementan, según Shopify), TikTok Shop arrasando (+108% YoY) y livestream shopping preparándose para despegar en US ($120B en 2025 frente a los $1,2T de China, con un CAGR estimado del 47% hasta los $680B en 2030).

👨🎓 Tendencias en eCommerce

Esta semana nos juntamos los representantes de cada departamento de la agencia para hablar sin filtros de cómo está cambiando el ecosistema, novedades en Google Ads y los riesgos ocultos de Performance Max, atribución basada en datos para mejorar ROAS, el nuevo SEO con buscadores IA, lo que se está moviendo en Shopify, automatización con IA sin perder el foco y UX para vender más.

Si llevas tiendas online o trabajas en agencia, no puedes perdértero, el episodio viene con timestamps por bloque para que saltes directo al tema que te interese (scripts + IA para alertas automáticas, Search Everywhere, Shopify Magic, IA creando anuncios sola…).

📺 Checklist .htaccess para SEO

🧰Herramientas / recursos

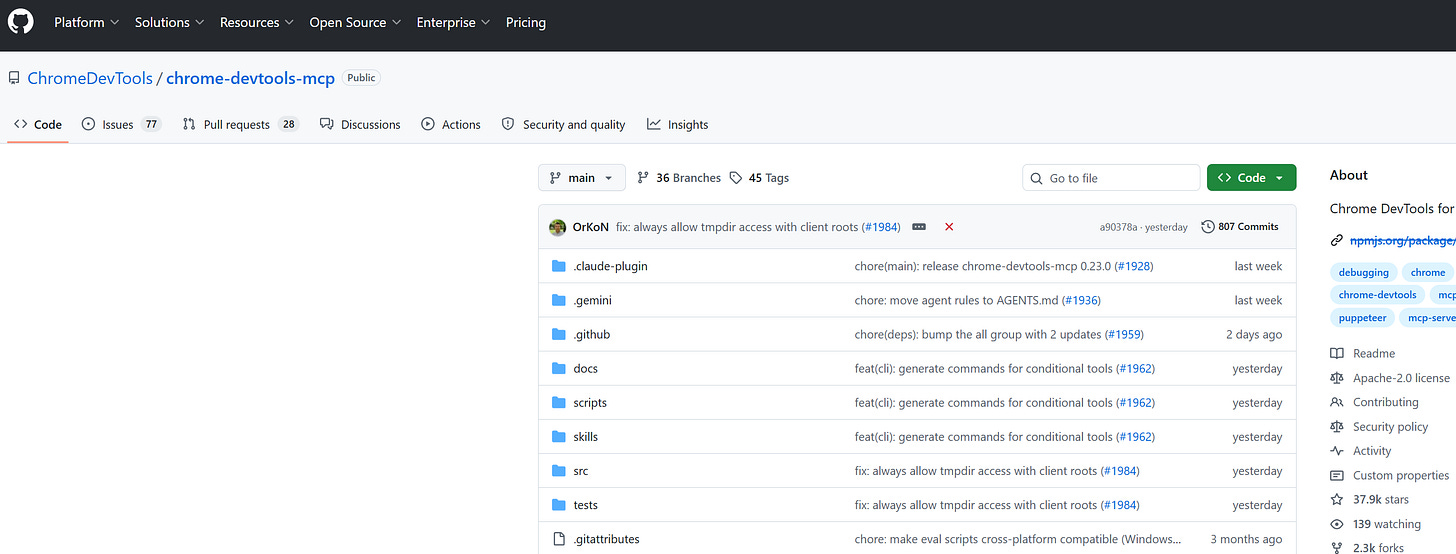

El equipo de Chrome DevTools ha publicado un servidor MCP oficial que permite a tu agente (Claude Code, Gemini, Cursor, Copilot…) controlar e inspeccionar un Chrome real. Va por la versión 0.20.3 y ya acumula más de 31k estrellas en GitHub.

Para SEO técnico encaja bien cuando quieres que un agente compare HTML fuente vs. renderizado (lo que comentaba Lino con shot-scraper, ahora directo desde MCP), lance una traza de performance y te devuelva insights accionables, o verifique que un cambio en producción no rompe nada a nivel de network o consola.

🏛️El día que Google compró el aire de Internet

Abril de 2007 (¡hace casi 2 décadas!). En aquel entonces, Google era el rey indiscutible de las búsquedas (el Search), pero fuera de su buscador, en el resto de páginas web, el ecosistema de banners era un caos de redes publicitarias fragmentadas. Microsoft, Yahoo! y AT&T también querían el trono.

¿Qué era DoubleClick?

No era una agencia de publicidad, era una infraestructura. Tenían la tecnología (ad-servers) que permitía a los anunciantes colocar sus banners en miles de webs y, lo más importante, medir quién hacía clic. Eran los dueños de los canales de publicidad.

La guerra de ofertas

Google no estaba solo. Microsoft estaba convencido de que DoubleClick era su billete de vuelta al liderato de internet. Sin embargo, Eric Schmidt (entonces CEO de Google) actuó rápido y puso sobre la mesa 3.100 millones de dólares en efectivo.

Para la época, fue una cifra astronómica, casi el doble de lo que Google había pagado por YouTube apenas un año antes.

El movimiento maestro, el nacimiento de la publicidad programática

Con esta compra, Google logró algo que sus competidores no vieron venir:

Unión de datos: Combinaron lo que la gente buscaba (Intención) con lo que la gente veía mientras navegaba (Display).

El ecosistema perfecto: Crearon un circuito cerrado donde ellos controlaban la tecnología del vendedor (el medio), la del comprador (el anunciante) y el mercado donde se cruzaban (el Ad Exchange).

El efecto monopolio y la controversia

La compra fue tan agresiva que la Comisión Federal de Comercio (FTC) tardó casi un año en aprobarla por miedo a que Google se volviera “demasiado poderoso”. Al final, la aprobaron argumentando que el mercado de la publicidad online era “dinámico”. El resto es historia: hoy, la mayor parte de los ingresos de Google siguen naciendo de esa integración.

La moraleja para el SEO y el marketing hoy

Esta historia nos enseña que quien controla la infraestructura, controla el mercado. En SEO, no solo luchamos por aparecer en la búsqueda, sino por entender cómo el ecosistema publicitario (nacido de DoubleClick) empuja constantemente los resultados orgánicos hacia abajo.

¿Sabías que tras perder a DoubleClick, Microsoft tuvo que “comprar por desesperación” a una empresa llamada aQuantive por 6.000 millones (el doble que Google)? Fue un desastre absoluto y terminaron declarando la pérdida total de la inversión pocos años después. Google ganó la guerra en un solo despacho.

Estamos en contacto

Puedes encontrarme en Linkedin, Twitter, mi blog, en mi canal de Youtube o trabajando a diario en la Agencia VisibilidadOn

🤜🤛 Si quieres que escriba sobre un tema concreto, que analice alguna web en vivo, que pruebe alguna herramienta, patrocinar la newsletter o financiarme un viaje en moto por Europa ahora es el momento, ¡contáctame!

📚 Si te has perdido alguna publicación o quieres revisar las anteriores, tienes el archivo disponible online para tí.